複数の画像やテキストの解釈 機械学習 - Section 155

データから洞察を抽出し、予測を行う際の機械学習の力を発見してください

「TableGPTという統合された微調整フレームワークにより、LLMが外部の機能コマンドを使用してテーブルを理解し、操作できるようになります」

表は、財務分析、サプライチェーン管理、ヘルスケア分析など、さまざまなコンテキストでデータ駆動型の意思決定の基盤として...

ReLoRa GPU上で大規模な言語モデルを事前学習する

ReLoRaは、各イテレーションごとにわずかな訓練可能なパラメータのみを活性化させながら、LoRaをリセットして事前学習を可能...

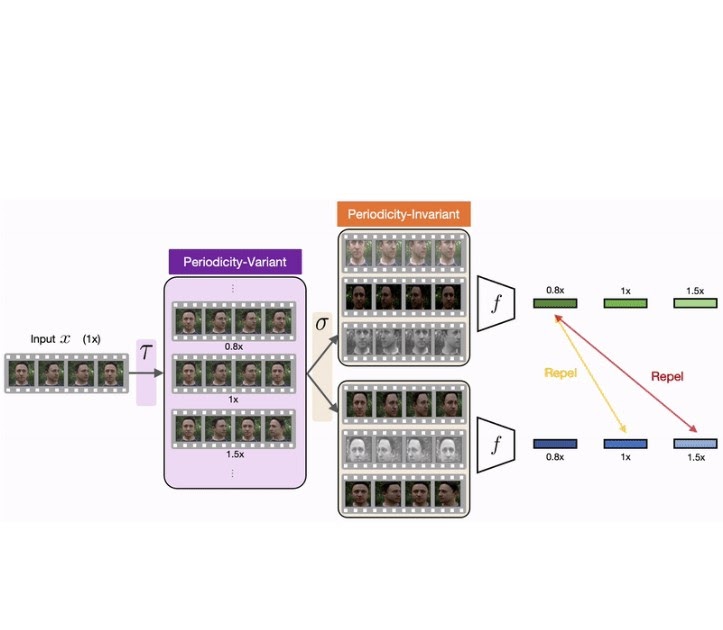

SimPer:周期的なターゲットの簡単な自己教示学習

Googleのスタッフ研究者であるDaniel McDuffと学生研究者のYuzhe Yangによって投稿されました。 周期的なデータ(心拍や地球...

LMSYS ORG プレゼント チャットボット・アリーナ:匿名でランダムなバトルを行うクラウドソーシング型 LLM ベンチマーク・プラットフォーム

多くのオープンソースプロジェクトは、特定のタスクを実行するためにトレーニングできる包括的な言語モデルを開発しています...

「Mojo」という新しいプログラミング言語は、Pythonの使いやすさとCのパフォーマンスを組み合わせ、AIハードウェアのプログラム可能性とAIモデルの拡張性を他のどの言語よりも優れたものにします

人工知能の領域は急速に発展しています。近年、AIとMLは徐々に進化し、今ではすべての組織が製品にAIを導入し、その応用を普...

MPT-7Bをご紹介します MosaicMLによってキュレーションされた1Tトークンのテキストとコードでトレーニングされた新しいオープンソースの大規模言語モデルです

MosaicMLは最近、予測分析と意思決定のアプローチを変革する画期的なツール、MPT-7Bを発表しました。この新しいツールは、最...

AIとディープラーニングに最適なGPU

AIとディープラーニングに深入りする際には、AIリグに適したGPUを選ぶことが重要です適切なGPUを選ぶことで、高度なタスクに...

ラミニAIに会ってください:開発者が簡単にChatGPTレベルの言語モデルをトレーニングすることができる、革命的なLLMエンジン

LLMをゼロから教えることは難しいです。なぜなら、微調整されたモデルがなぜ失敗するのかを理解するのには時間がかかり、小さ...

MLCommonsは、臨床効果を提供するためのAIモデルのベンチマークを行うためのオープンソースプラットフォームであるMedPerfを紹介します

AIモデルの有効性を大規模かつ多様な実世界データセットで評価することは、医療AIの臨床翻訳において重要です。MLCommonsとい...

医学論文のLLaMAのFine-tuning:バイオメディカルQAベンチマークで高い性能を発揮するPMC-LLaMA-Aモデルに出会ってください

大規模言語モデル(LLM)の開発、例えばOpenAIのChatGPTやGPT-4などは、自然言語処理、コンピュータビジョン、バイオメディカ...

- You may be interested

- 新しいツールが人々がAIモデルを評価する...

- 「世界最大の広告主がAIの力を受け入れる...

- 「OpenAIがオープンソースのGPTモデルのリ...

- なぜAIチップの将来がニューロモーフィッ...

- NVIDIAは、企業向けカスタム生成AIモデル...

- 「埋め込みを使った10の素敵なこと!【パ...

- 遺伝的アルゴリズム:エンゲージメントを...

- トランスフォーマーのA-Z:知っておくべき...

- 「マルチコードダイアグラムの紹介:複雑...

- オラクルと一緒にXRを開発しよう、エピソ...

- 「40歳以上の方におすすめのクールなAIツ...

- パンダの力を解放する:.locと.ilocの深い...

- ChatGPTを使用して顧客の洞察を見つける

- 「REPLUG」をご紹介しますこれは、凍結さ...

- ポイントクラウド用のセグメント化ガイド...

Find your business way

Globalization of Business, We can all achieve our own Success.