「LLMsはインコンテキスト学習を達成するためにすべてのレイヤーが必要ですか?」

LLMsのすべてのレイヤーはインコンテキスト学習に必要ですか?

アマゾンサイエンスからの最新の論文は、LLSに関する最も重要な質問の一つについて、いくつかの光を当てています。

最近、AIに特化した教育ニュースレターを始めましたが、既に16万人以上の購読者がいます。TheSequenceは、5分で読める、ノンヒュープ(つまり、宣伝、ニュースなどはなし)のML指向のニュースレターです。目標は、機械学習プロジェクト、研究論文、および概念に関連する最新情報を提供することです。以下のリンクから購読してみてください:

TheSequence | Jesus Rodriguez | Substack

機械学習、人工知能、データに関する最新情報を常に把握するための最良の情報源…

thesequence.substack.com

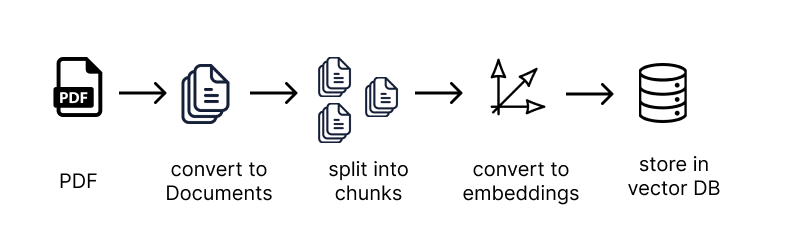

大規模言語モデル(LLM)は、特にChatGPTの登場とともに、最近注目を集めています。これらのモデルは通常、大規模なデータセットで事前学習され、新しいバリアントでは強化学習を組み込んで指示に従い、人間のフィードバックを統合するようになっています。LLMが示した興味深い能力の一つは、コンテキスト学習です。この学習パラダイムの拡張に関して、事前学習データのボリュームが一定の場合、より大きなLLMの方が小さいモデルよりも優れたパフォーマンスを発揮し、さまざまなタスクに対して高い柔軟性を示すことが観察されました。

LLMを取り巻く常に興味深い問題の一つは、ICLを可能にするためにすべての構成要素が必要かどうかということです。 アマゾンサイエンスの最新の論文は、コンテキスト学習とアーキテクチャの解釈可能性の観点でモデルのスケールの重要性を探求しています。 研究で取り組まれた主な問いは、効果的なコンテキスト学習においてLLMのすべてのコンポーネントが本当に不可欠かどうかということです。

- 「Glazeとの出会い:アーティストが生成AIモデルによる再現を防ぐための新しいAIツール」

- PoisonGPT ハギングフェイスのLLMがフェイクニュースを広める

- 「シエラディビジョンがNVIDIA Omniverseを使用して作成した3つのエピックなプロジェクトを紹介します」

実験

実験には、Amazon Scienceが昨年MetaによってGPT-3のオープンソースのレプリカとしてリリースされた66億パラメータのOPT-66Bモデルを使用しました。研究の結果は、モデルのかなりの部分が示しています…

We will continue to update VoAGI; if you have any questions or suggestions, please contact us!

Was this article helpful?

93 out of 132 found this helpful

Related articles